提示链(Prompt Chain)是大语言模型(LLM)处理复杂任务的核心优化范式,其核心逻辑是 “分而治之”—— 将单一大模型难以直接驾驭的复杂任务,拆解为一系列独立、聚焦、可管理的子问题,通过专门设计的提示词(Prompt)逐一解决,同时构建 “前序输出→后序输入” 的依赖链,让模型在逐步迭代中逼近最终解决方案。这种模块化、流程化的方式,不仅突破了单一提示处理复杂任务的局限性,更显著提升了 LLM 输出的可靠性、可解释性与可控性,是构建高级 AI 智能体(Agent)的基础框架。

一、核心定义与本质

核心定义

提示链是一种结构化的 LLM 交互策略:通过任务分解将复杂目标拆分为 N 个连续子任务,为每个子任务设计专用提示词,使每个步骤仅聚焦解决单一维度的问题;同时,前序子任务的输出(含结果、上下文)作为后序子任务的输入,形成闭环依赖链,最终通过多步协同完成复杂目标。

本质特征

- 模块化拆分:每个子任务是独立模块,可单独设计、优化、调试(如 “数据提取”“格式转换”“内容润色” 可拆分为三个独立模块);

- 依赖传递:步骤间通过 “输入 - 输出” 强关联,前序结果为后序提供必要上下文(如 “提取的技术规格” 是 “转换为 JSON” 的前提);

- 目标收敛:每一步都向最终目标靠近,避免单一提示的 “认知过载”(如复杂报告生成拆分为 “定大纲→填内容→润色”,逐步收敛到高质量报告)。

二、核心价值

相比传统 “一次性复杂提示”,提示链的价值体现在可靠性、可管理性、扩展性三大维度,完美解决复杂任务处理的痛点:

|

核心价值 |

具体内涵 |

实践体现 |

|

降低认知负荷 |

拆分后的子任务更简单,LLM 无需同时处理多约束、多目标,减少 “顾此失彼” |

生成市场报告时,LLM 无需同时兼顾 “数据提取、趋势分析、文案撰写”,仅需聚焦单一步骤(如先提取数据) |

|

提升可解释性 |

每个步骤的输入输出可追溯,问题定位更精准(如 “格式错误” 仅需排查 “转换步骤”) |

代码生成失败时,可快速判断是 “伪代码设计问题” 还是 “代码实现问题”,无需重构整个提示 |

|

强化可控性 |

单个步骤可独立优化(如调整 “数据提取提示” 提升准确性),不影响整体流程 |

优化报告文案时,仅修改 “润色步骤” 的提示词,无需改动 “大纲设计”“数据整合” 步骤 |

|

支持工具集成 |

可在任意步骤插入外部工具(API、数据库、检索),突破 LLM 训练数据局限 |

信息提取后,通过中间步骤调用知识库验证数据准确性,再进入后续处理 |

|

容错性更强 |

前序步骤的小错误可通过后序步骤修正(如 “提取遗漏字段” 可在 “验证步骤” 补全) |

数据提取时遗漏 “内存” 参数,可在 “完整性校验步骤” 触发重试,补充该字段 |

三、工作原理

提示链的运作核心是 “任务分解→依赖传递→目标收敛”,其完整工作流程可拆解为三个关键环节:

1. 任务结构化分解(核心前提)

将复杂任务拆分为 “逻辑连贯、粒度适中” 的子任务序列,需遵循三大原则:

- 单一职责:每个子任务仅解决一个具体问题(如 “生成邮件” 拆分为 “提取核心信息→确定收件人→起草正文→检查格式”,而非 “提取 + 起草” 合并);

- 依赖有序:后序子任务必须依赖前序结果(如 “润色文案” 需在 “起草正文” 之后,不可颠倒);

- 粒度可控:子任务不可过细(如拆分为 “写标题→写第一段→写第二段” 可能导致冗余),也不可过粗(如 “数据处理 + 报告生成” 合并仍会导致认知过载)。

▶ 示例:“从学术论文中提取研究方法并生成技术总结” 的分解:

- 提取论文中的 “研究方法” 章节文本;

- 总结研究方法的核心步骤与技术细节;

- 验证总结内容的完整性(是否覆盖关键参数、流程);

- 将总结转换为 “技术手册” 风格的结构化文案。

2. 依赖传递与上下文管理(核心机制)

提示链的关键是 “前序输出→后序输入” 的无缝衔接,需解决两个核心问题:

- 数据传递:前序输出需以 “后序可解析” 的格式传递(如结构化的 JSON、明确的列表),避免模糊表述;▶ 反例:前序输出 “处理器 3.5GHz,内存 16G”,后序难以精准提取字段;▶ 正例:前序输出

{"cpu": "3.5 GHz八核", "memory": "16GB", "storage": "1TB NVMe SSD"},后序可直接复用。 - 上下文保留:关键背景信息(如用户需求、任务目标)需在步骤间传递,避免 “丢失初始意图”;▶ 实践:将 “系统提示(如‘生成技术总结需面向工程师’)” 作为全局上下文,在每个子任务的提示中复用。

3. 工具集成与动态优化(扩展能力)

提示链可在任意步骤插入外部工具,突破 LLM 的原生局限,形成 “LLM + 工具” 的增强工作流:

- 信息补充工具:如在 “数据提取” 后调用检索工具(RAG)验证信息准确性;

- 格式转换工具:如将 “文本总结” 通过 API 转换为表格;

- 逻辑校验工具:如用代码执行工具验证 “技术总结中的公式推导” 是否正确。

▶ 示例:“市场分析报告生成” 的增强提示链:

- 提取行业报告核心数据(LLM);

- 调用数据库 API 补充最新市场数据(工具);

- 整合数据并识别趋势(LLM);

- 用图表工具生成趋势可视化(工具);

- 结合数据与图表撰写分析报告(LLM)。

四、单一提示的局限性

传统单一提示处理复杂任务时,LLM 的 “认知能力” 会达到瓶颈,导致一系列问题,而提示链通过拆分从根源解决:

|

单一提示的局限性 |

具体表现 |

提示链的解决方案 |

|

忽视部分指令 |

复杂提示含多约束(如 “提取 3 类信息 + 转换格式 + 润色”),LLM 易遗漏次要约束 |

每个子任务仅含 1-2 个核心约束,聚焦性强,不易遗漏 |

|

丢失初始上下文 |

长文本输入时,LLM 难以记住开头的关键需求(如 “面向 C 端用户”) |

上下文在步骤间传递,可通过系统提示固定核心需求,全程不丢失 |

|

早期错误被放大 |

第一步的小错误(如数据提取错误)会在后续生成中持续扩散 |

中间步骤可插入 “验证模块”,及时修正错误,避免扩散 |

|

上下文窗口超限 |

复杂任务的输入 + 输出易超出 LLM 的 Token 限制(如 10 万字文档分析) |

分步处理,每步仅传递必要信息,控制 Token 用量 |

|

认知负担导致幻觉 |

多步推理任务(如逻辑推导)中,LLM 因 “想当然” 产生虚假信息 |

拆分后每步仅需简单推理,降低幻觉概率,且可通过工具验证推理结果 |

五、关键技术要点

1. 结构化输出

提示链的可靠性高度依赖步骤间数据传递的准确性,因此强制结构化输出是核心准则:

- 推荐格式:JSON(优先)、Markdown 表格 / 列表、固定模板(如 “【CPU】xxx【内存】xxx”);

- 工具支撑:使用 LangChain 的

PydanticOutputParser等工具,强制 LLM 按指定 schema 输出,避免格式混乱; - ▶ 示例提示:“将以下技术规格转换为 JSON,必须包含 cpu(字符串)、memory(字符串)、storage(字符串)三个键,缺失字段填‘未知’:{specifications}”。

2. 步骤粒度控制

- 粒度太粗:失去提示链的核心价值(如 “数据提取 + 报告生成” 合并,仍存在认知过载);

- 粒度太细:增加步骤冗余,降低效率(如 “写标题→写第一段→写第二段” 拆分过细);

- 黄金法则:每个子任务的处理逻辑可在 1-2 句内说清,且输出结果能直接服务于下一个子任务。

3. 上下文裁剪

- 核心原则:仅向后序步骤传递 “必要上下文”,剔除冗余信息(如前序步骤的调试日志、无关描述);

- 实践方法:在每个步骤末尾添加 “上下文筛选逻辑”,如 “仅保留提取的技术规格,忽略其他内容”;

- 工具支撑:使用 LangChain 的

ContextualCompression工具,自动压缩前序输出,保留关键信息。

4. 错误重试机制

- 触发条件:当步骤输出不符合预期(如格式错误、信息缺失)时,自动触发重试;

- 重试策略:

-

- 明确错误原因(如 “缺失 storage 字段”);

- 调整提示词(如 “重点提取存储相关信息”);

- 重新运行该步骤,直至输出符合要求;

- ▶ 示例:在 “数据提取步骤” 后添加验证逻辑,若 JSON 中缺少某字段,自动返回 “请补充 {字段名} 信息” 的提示,重新调用 LLM。

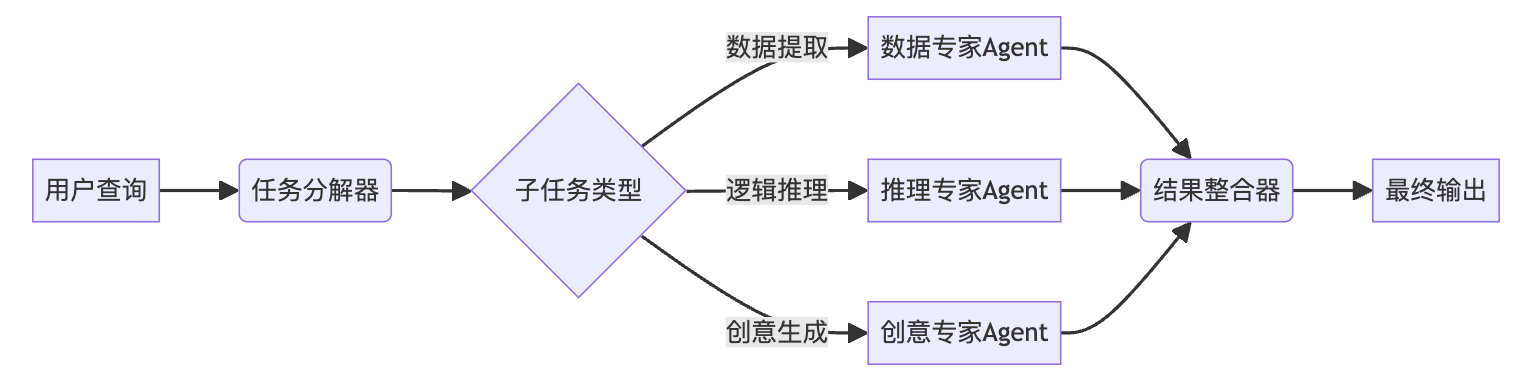

5. 动态分支

复杂任务中,中间结果可能触发不同处理路径,提示链需支持 “动态分支”:

- 实现逻辑:在关键步骤后添加 “判断节点”,根据输出结果选择后续流程;

- ▶ 示例:“用户需求分析” 提示链:

-

- 分析用户查询意图(LLM);

- 判断意图类型:若为 “常规咨询”→ 直接生成答案;若为 “复杂问题”→ 触发多步检索 + 整合流程;若为 “情感诉求”→ 转人工处理。

六、典型应用场景

提示链的模块化特性使其适配所有 “多步骤、高复杂度、强流程化” 的 LLM 任务,以下是七大核心场景及落地示例:

1. 信息处理工作流(如文档分析、数据提取)

- 核心目标:从非结构化数据中提取、整合、转换信息;

- 典型链:

文档文本提取 → 核心信息总结 → 特定实体提取 → 知识库验证 → 结构化报告生成; - ▶ 示例:企业年报分析:提取年报中的 “营收数据”→ 总结营收趋势 → 提取 “核心业务营收占比”→ 调用财务数据库验证数据 → 生成可视化分析报告。

2. 复杂问答(如多步骤推理、跨领域问答)

- 核心目标:解决需多轮推理或跨知识域的问题;

- 典型链:

拆解核心子问题 → 逐一检索子问题答案 → 验证答案一致性 → 整合逻辑形成最终回答; - ▶ 示例:“某政策对新能源汽车行业的影响”:拆解为 “政策核心条款”“行业现状”“条款与现状的关联”→ 分别检索信息 → 验证关联逻辑 → 整合为全面分析。

3. 数据提取与转换(如表单生成、格式标准化)

- 核心目标:将非结构化文本转换为标准化结构化数据;

- 典型链:

非结构化文本提取字段 → 验证字段完整性 → 缺失字段重试提取 → 格式标准化(JSON/Excel); - ▶ 示例:简历信息整理:提取 “姓名、工作年限、技能”→ 检查是否缺失 “期望薪资”→ 若缺失,生成补充查询→ 转换为标准化招聘表单。

4. 内容生成工作流(如报告、文案、代码)

- 核心目标:生成高质量、结构化、符合需求的内容;

- 典型链:

需求分析→ 主题/大纲生成 → 分模块起草 → 内容润色 → 合规性检查; - ▶ 示例:产品推广文案:分析目标用户(年轻群体)→ 确定 “潮流 + 实用” 主题 → 起草标题、正文、CTA→ 润色语言风格 → 检查是否含违规宣传词。

5. 有状态对话智能体(如客服、助手)

- 核心目标:维持对话上下文一致性,动态响应用户需求;

- 典型链:

用户输入解析(意图+实体)→ 更新对话状态 → 基于状态生成响应 → 维护历史上下文; - ▶ 示例:电商客服智能体:解析用户 “查询订单物流” 意图 + 订单号 → 更新状态 “待查询物流”→ 调用物流 API 获取信息 → 生成含订单号的物流回复 → 保存对话历史。

6. 代码生成与优化(如复杂程序开发)

- 核心目标:生成可运行、高质量、易维护的代码;

- 典型链:

需求拆解→ 伪代码/架构设计 → 分模块编写代码 → 错误检测 → 代码优化 → 生成测试用例; - ▶ 示例:Python 数据可视化工具:拆解需求(数据读取 + 图表生成 + 交互功能)→ 设计架构(模块化)→ 编写核心函数 → 检测语法错误 → 优化代码性能 → 生成单元测试。

7. 多模态推理(如图文结合任务)

- 核心目标:融合多模态信息(文本、图像)完成任务;

- 典型链:

图像文本提取(OCR)→ 图文信息关联 → 基于关联信息推理 → 生成多模态输出; - ▶ 示例:产品说明书解析:OCR 提取图像中的按钮说明 → 关联文本中的功能描述 → 推理 “按钮操作与功能的对应关系”→ 生成图文结合的操作指南。

七、实战:用 LangChain 构建进阶提示链(含结构化输出与错误处理)

基于用户提供的基础示例,扩展为 “数据提取→格式验证→错误重试” 的进阶提示链,展示工业级落地的核心逻辑:

1. 环境准备

pip install langchain langchain-openai langchain-core pydantic2. 代码实现(技术规格提取与 JSON 转换)

import os

from langchain_openai import ChatOpenAI

from langchain_core.prompts import ChatPromptTemplate

from langchain_core.output_parsers import PydanticOutputParser

from langchain_core.exceptions import OutputParserException

from pydantic import BaseModel, Field

# 1. 定义结构化输出模型(强制LLM按指定格式输出)

class TechSpecs(BaseModel):

cpu: str = Field(description="处理器规格,含频率、核心数")

memory: str = Field(description="内存规格,含容量、类型")

storage: str = Field(description="存储规格,含容量、接口类型")

# 2. 初始化LLM与解析器

llm = ChatOpenAI(model="gpt-4", temperature=0)

parser = PydanticOutputParser(pydantic_object=TechSpecs)

# 3. 定义各步骤提示词

# 步骤1:提取技术规格(结构化输出)

prompt_extract = ChatPromptTemplate.from_template("""

从以下文本中提取处理器(cpu)、内存(memory)、存储(storage)的技术规格,严格按照输出格式要求返回:

{format_instructions}

文本输入:{text_input}

""").partial(format_instructions=parser.get_format_instructions())

# 步骤2:验证规格完整性(检查是否有缺失字段)

prompt_validate = ChatPromptTemplate.from_template("""

以下是提取的技术规格:

{specs_json}

请检查是否包含cpu、memory、storage三个字段,且每个字段有具体值(非空、非“未知”)。

若完整:返回“验证通过”;

若缺失:明确指出缺失的字段,并生成补充提取提示(引导LLM重新提取该字段)。

""")

# 步骤3:重试提取缺失字段

prompt_retry = ChatPromptTemplate.from_template("""

之前提取的技术规格缺失{missing_fields}字段,请从以下文本中重新提取该字段的具体信息,仅返回字段值:

文本输入:{text_input}

""")

# 4. 构建提示链逻辑(含错误处理与重试)

def tech_specs_chain(text_input: str) -> TechSpecs:

# 步骤1:初始提取

extract_chain = prompt_extract | llm | parser

try:

specs = extract_chain.invoke({"text_input": text_input})

print("初始提取成功:", specs.dict())

return specs

except OutputParserException as e:

print("初始提取格式错误,进入验证流程")

# 步骤2:验证缺失字段(先获取原始文本输出,再验证)

raw_extract = (prompt_extract | llm).invoke({"text_input": text_input}).content

validate_result = (prompt_validate | llm).invoke({"specs_json": raw_extract}).content

if "验证通过" in validate_result:

# 格式错误但信息完整,重新解析

return parser.parse(raw_extract)

else:

# 提取缺失字段,重试

missing_fields = [f for f in ["cpu", "memory", "storage"] if f not in raw_extract.lower()]

print(f"缺失字段:{missing_fields},触发重试")

retry_result = (prompt_retry | llm).invoke({

"missing_fields": ", ".join(missing_fields),

"text_input": text_input

}).content

# 整合重试结果与原始结果,生成最终JSON

final_specs = parser.parse(

raw_extract.replace("未知", retry_result) if missing_fields else raw_extract

)

print("重试后提取成功:", final_specs.dict())

return final_specs

# 5. 运行链

input_text = "新款笔记本电脑配备3.5 GHz八核处理器、16GB DDR5内存,存储为1TB NVMe SSD"

final_result = tech_specs_chain(input_text)

print("最终结构化结果:", final_result.dict())3. 代码核心逻辑解读

- 结构化约束:通过

PydanticOutputParser强制 LLM 输出指定 JSON 格式,避免步骤间数据解析错误; - 错误处理:捕获格式错误后,通过验证步骤定位缺失字段,触发定向重试,提升链的容错性;

- 模块化设计:每个步骤的提示词独立,可单独优化(如调整

prompt_retry的引导逻辑,提升缺失字段提取准确率)。

八、提示链的工具生态与框架选择

构建复杂提示链需依赖专门的框架管理步骤依赖、上下文、工具集成,以下是主流框架对比:

|

框架 |

核心优势 |

适用场景 |

代表功能 |

|

LangChain |

生态丰富、工具集成能力强、支持多 LLM |

快速原型开发、线性提示链、工具集成 |

链式调用(Chain)、提示模板、输出解析器 |

|

LangGraph |

支持循环、分支、状态管理,适合复杂工作流 |

智能体开发、动态分支提示链 |

节点定义、边条件、状态存储 |

|

LlamaIndex |

专注文档处理,上下文管理优化 |

文档分析、信息提取类提示链 |

文档加载、节点拆分、上下文压缩 |

|

Haystack |

适合大规模检索增强型提示链 |

RAG + 提示链融合场景 |

检索节点、文档存储、流水线管理 |

▶ 选择建议:

- 简单线性链(如数据转换):用 LangChain;

- 复杂分支 / 循环链(如智能体):用 LangGraph;

- 文档相关任务(如年报分析):用 LlamaIndex;

- 检索增强型任务(如结合 RAG 的问答):用 Haystack。

九、总结与未来方向

提示链的核心价值在于 “将复杂任务转化为 LLM 可驾驭的模块化工作流”,通过 “分而治之” 突破了单一提示的局限,是构建高级 AI 系统的基础。其核心要点可概括为:

- 拆分是前提:将复杂任务拆分为聚焦、有序的子任务;

- 结构化是关键:确保步骤间数据传递无歧义;

- 容错性是保障:通过验证、重试机制提升可靠性;

- 工具化是延伸:集成外部工具突破 LLM 原生能力。

未来,提示链将向三个方向演进:

- 自适应提示链:LLM 自主根据任务复杂度调整步骤粒度与流程;

- 多智能体提示链:多个 AI 智能体分工负责不同子任务,通过提示链协同;

- 多模态提示链:无缝融合文本、图像、语音等多模态数据,构建跨模态工作流。

掌握提示链,本质是掌握 “用 LLM 解决复杂问题的工程化思维”—— 它不仅能提升当前 LLM 应用的可靠性,更是未来 AI 智能体实现 “多步推理、自主决策、复杂任务处理” 的核心基石。

转载自CSDN-专业IT技术社区

原文链接:https://blog.csdn.net/2403_89428850/article/details/155845775