保姆级教程:用Docker轻松部署本地AI知识库(Ollama+Open WebUI)

你是不是也遇到过这些头疼事?

想用AI快速查点资料,却总担心把公司文件或个人笔记上传到不明不白的云端服务器;看着各种AI工具的订阅账单,感觉还没怎么用,钱就花出去了;最气人的是,有时候AI会一本正经地胡说八道,给出的答案还得自己花半天时间去核实真假;想在成堆的本地文档里精准找到一个知识点,更是像大海捞针。

如果上面任何一条戳中了你,那今天这个分享,你可得看好了。

我最近搞定了一个完全在你自己电脑上运行的AI知识库。简单来说,就是用 Docker 这个“打包神器”,把 Ollama(本地大模型) 和 Open WebUI(超好看的网页界面) 组合在一起。整个过程比安装一个普通软件还简单,绝对保姆级,有手就行。

它带来的好处是实实在在的:

• 🔒 关门聊天,绝对隐私:所有文档处理和问答都在你本机完成,数据不出门。

• 🆓 一次部署,永久免费:彻底告别API调用费,想怎么问就怎么问。

• 📚 答案有根有据,告别“幻觉”:AI的回答严格基于你喂给它的文档,不会胡编乱造。

• ⚡ 秒变知识“搜索引擎”:瞬间从你的海量本地文件中精准定位信息,效率拉满。

下面,我就手把手带你,用一杯咖啡的时间,把这个专属的“第二大脑”给搭起来。

一、安装Docker容器

关于使用Docker,作者有话说

简单来说,Docker 是一个能把软件和它运行所需的一切环境,打包成一个“标准化集装箱”的工具。

你可以把它想象成:

- 传统方式:你想在电脑上运行一个软件(比如 Ollama),需要手动安装它、安装它依赖的各种库、配置系统环境,步骤繁琐,还经常因为系统版本不同而出错。

- Docker 方式:软件开发者已经把软件和它需要的所有“零件”(操作系统库、配置文件、依赖项)都打包好,放在了一个叫“镜像”的集装箱里。你只需要用一条命令把这个集装箱(镜像)下载下来,然后“启动”它,它就能在任何支持 Docker 的电脑上以完全相同的方式运行起来,与电脑上原有的其他环境互不干扰。

为什么要用 Docker?

对于部署像“本地AI知识库”这样的复杂应用,Docker 带来了几个决定性的好处,这也是我们教程选择它的核心原因:

- 彻底解决“环境地狱”问题:Ollama 和 Open WebUI 各自有复杂的依赖。手动安装,你可能会陷入无尽的版本冲突、库缺失的调试中。Docker 镜像里包含了一切就绪的、经过验证的环境,确保你下载即用,100%复现教程效果。

- 实现“一键部署”:教程标题里的“轻松”和“保姆级”正是源于此。你不需要是系统管理员或开发者,只需要复制教程里的几条 docker run 命令,几分钟内就能获得一个功能完整、界面美观的 AI 知识库系统。它把最复杂的安装配置过程全部封装、自动化了。

- 保持系统纯净与隔离:Docker 容器像一个个独立的沙箱。你在里面安装、运行、卸载 Ollama和 Open WebUI,完全不会污染你电脑的主操作系统。想彻底删除时,直接删除容器和镜像即可,不留任何垃圾文件和配置残留。

- 一致性保障:无论是在 Windows、macOS 还是 Linux上,只要安装了 Docker,运行同一个镜像,得到的行为和结果就是完全一致的。这保证了教程的普适性,任何人按步骤操作都能成功。

回到我们的教程:《为什么要用 Docker 部署?》

如果不用 Docker,传统部署“Ollama + Open WebUI”的流程将是这样的:

- 手动安装并配置 Ollama,处理可能的系统权限和依赖问题。

- 手动部署 Open WebUI 的后端和前端,这通常需要安装 Node.js、Python 包管理等一系列工具,配置网络和反向代理。

- 手动将两者连接起来,并确保它们能相互通信。

- 整个过程充满不确定性,一个步骤出错就可能导致失败,且难以排查。

而使用 Docker 部署,流程简化为:

- 安装 Docker(一个标准化步骤)。

- 从 Docker Hub(一个“集装箱仓库”)拉取官方准备好的 Ollama 和 Open WebUI 镜像。

- 用一条配置好的命令启动它们,Docker 会自动处理网络连接、资源分配等所有底层细节。

结论:在这个教程中,使用 Docker 是“轻松”和“保姆级”的核心保障。它把一项原本需要专业运维知识的技术任务,变成了像安装普通软件一样简单的操作,让所有用户都能无障碍地享受本地化、私有化 AI 知识库带来的数据安全、零费用和精准问答的优势。

安装Docker

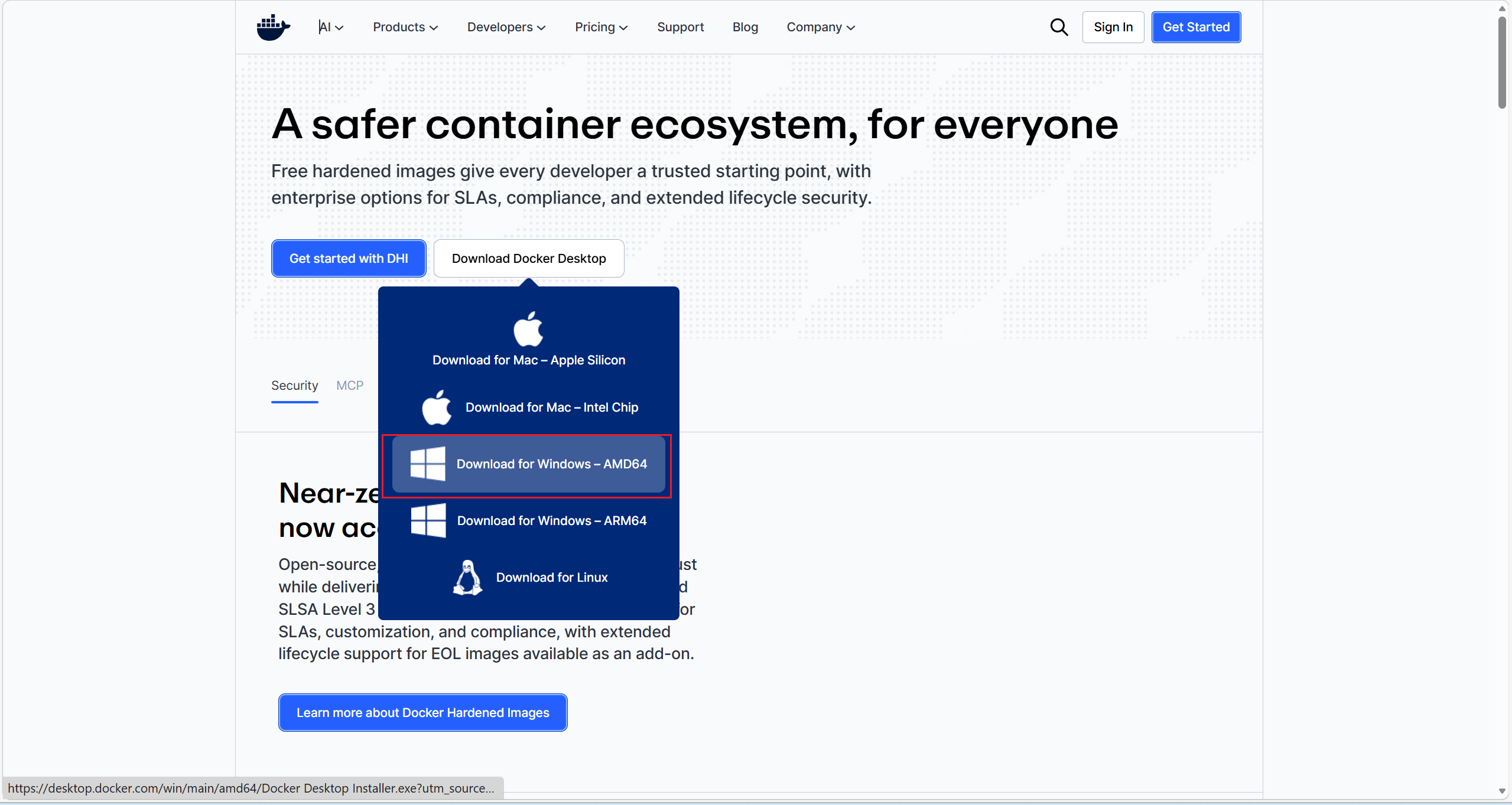

进入Docker官网,下载Docker桌面版安装包。

下载完安装包就长这样子:

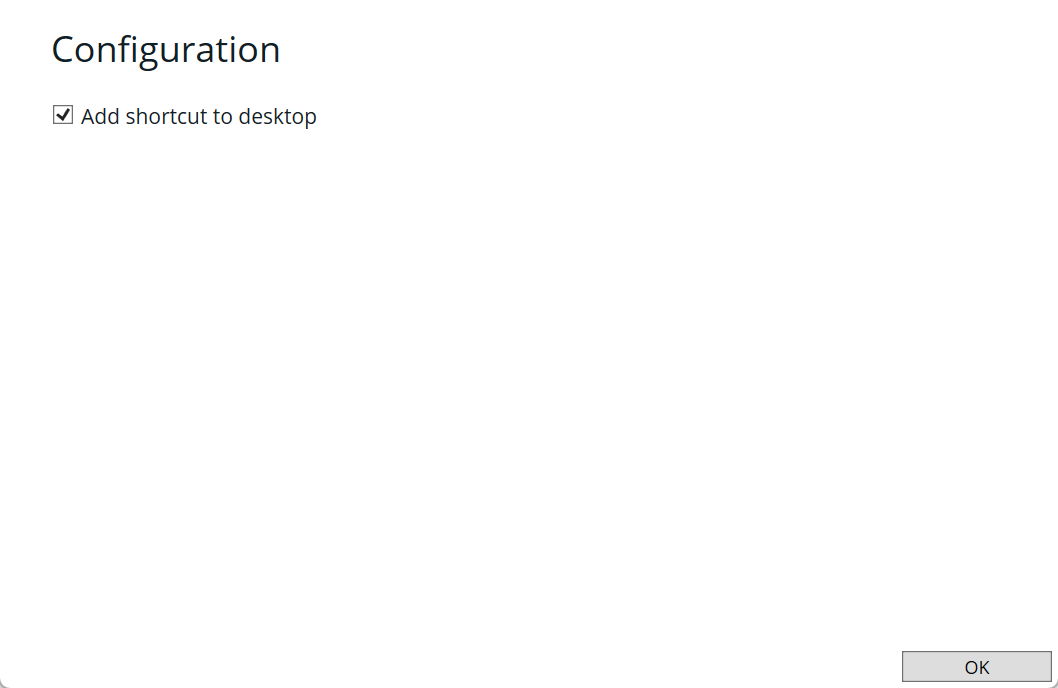

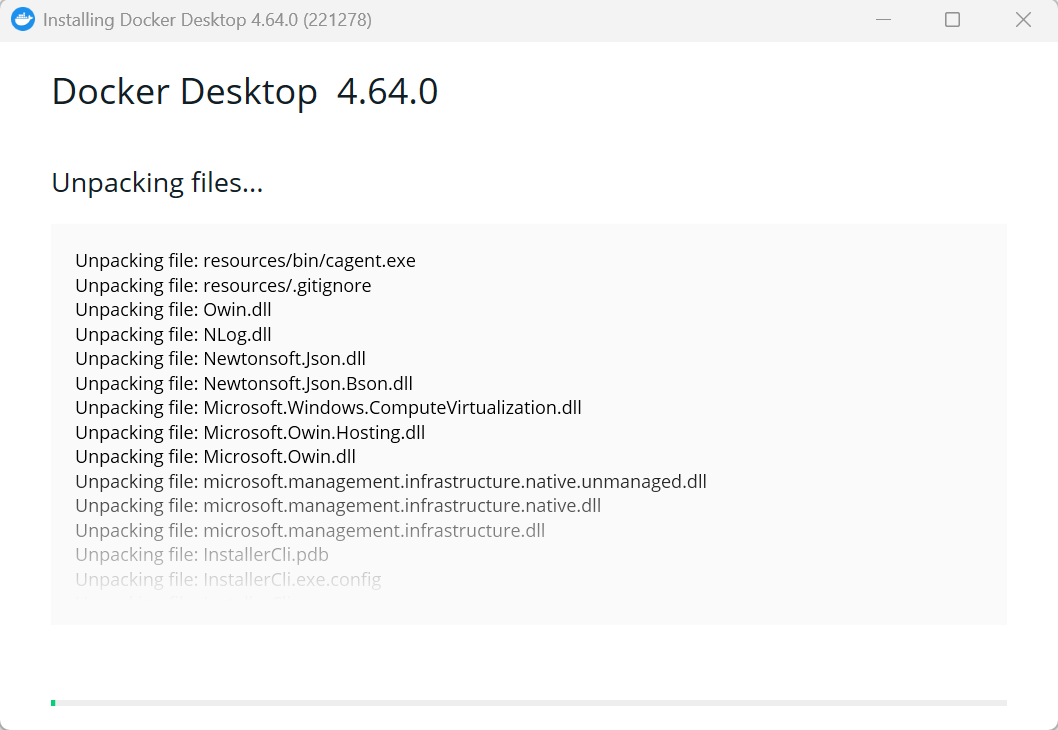

我们双击Docker安装包,弹出的窗口选择 是 ,这里勾选添加到桌面,点击 OK 开始安装:

安装完成后,桌面会显示一个小鲸鱼的图标,双击打开,选择Accept,跳过登录。

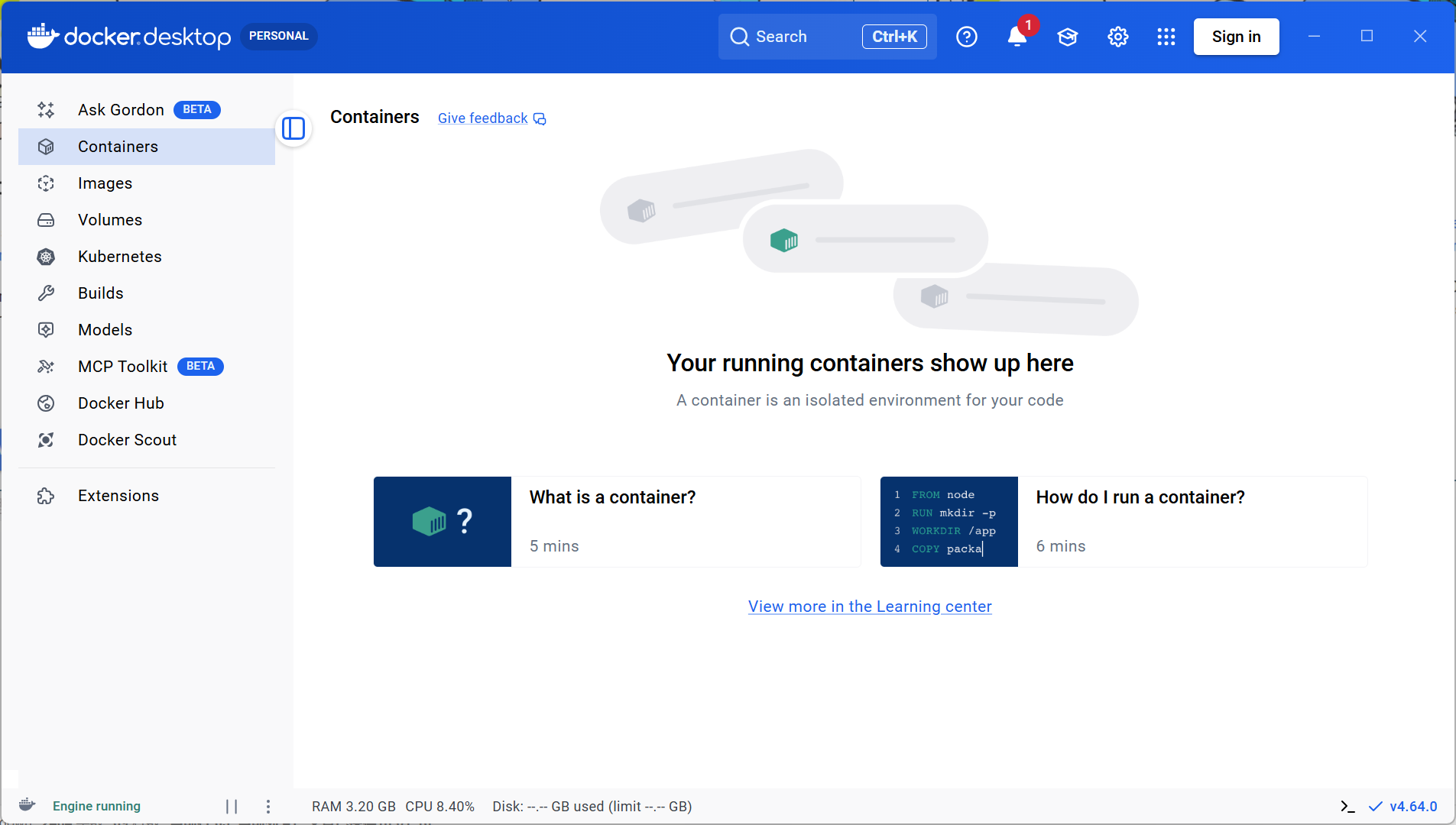

可以看到我们的Containers容器是空的。

Win+R打开终端,输入docker -v查看一下版本:

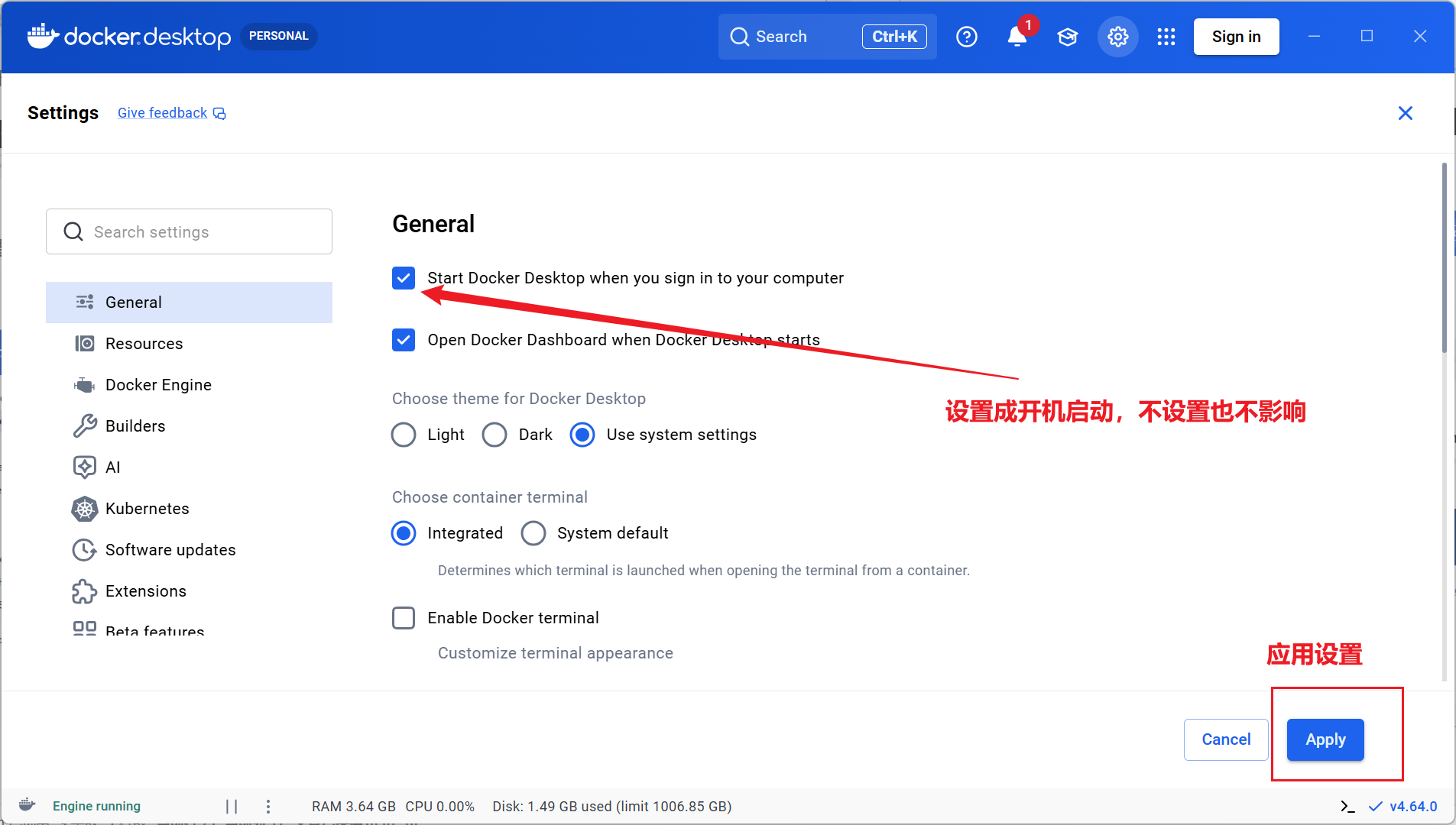

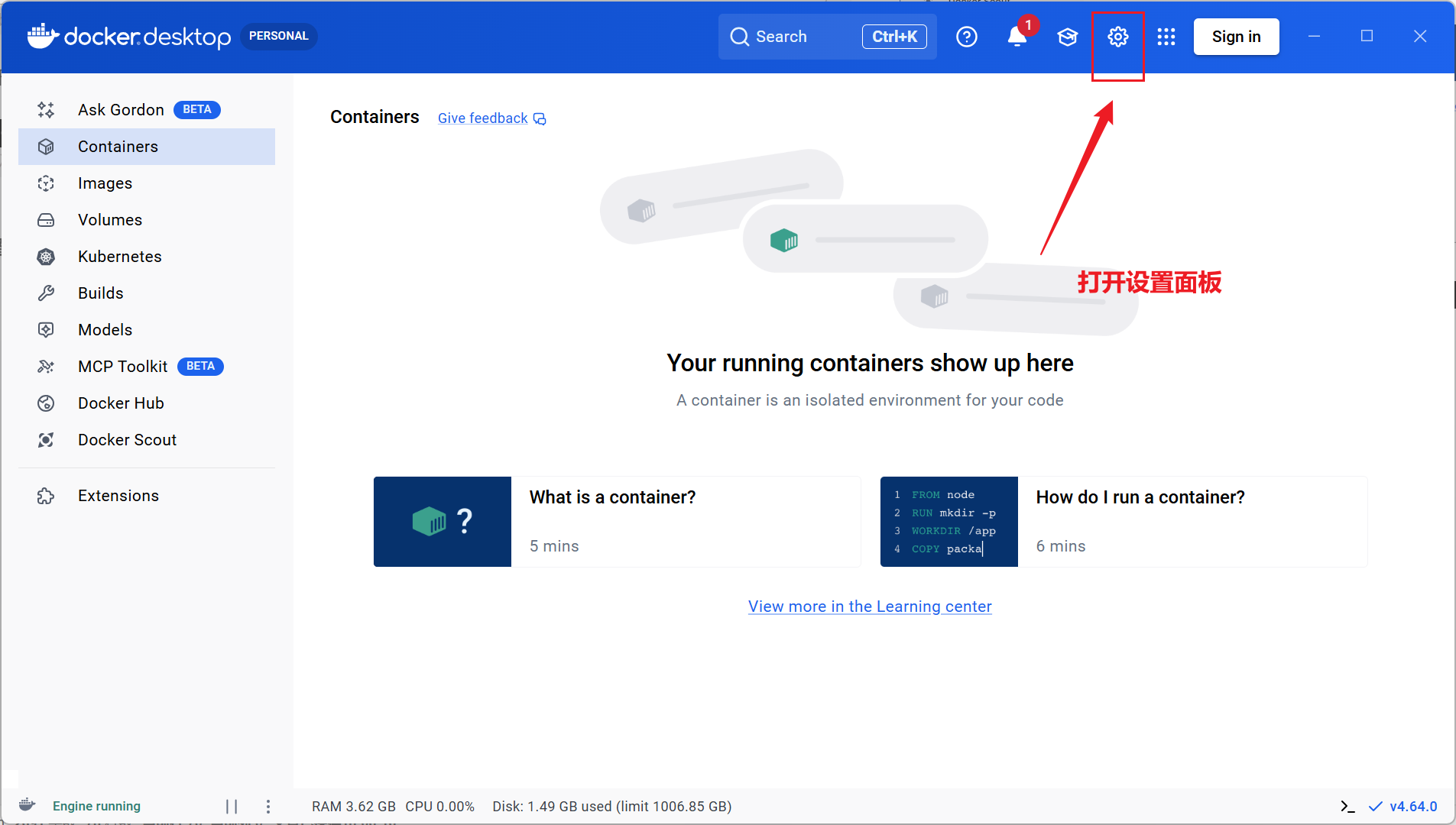

调整Docker配置

我们打开设置,在General中勾选开机启动选项,这样可以开机就系统你的知识库和大模型。

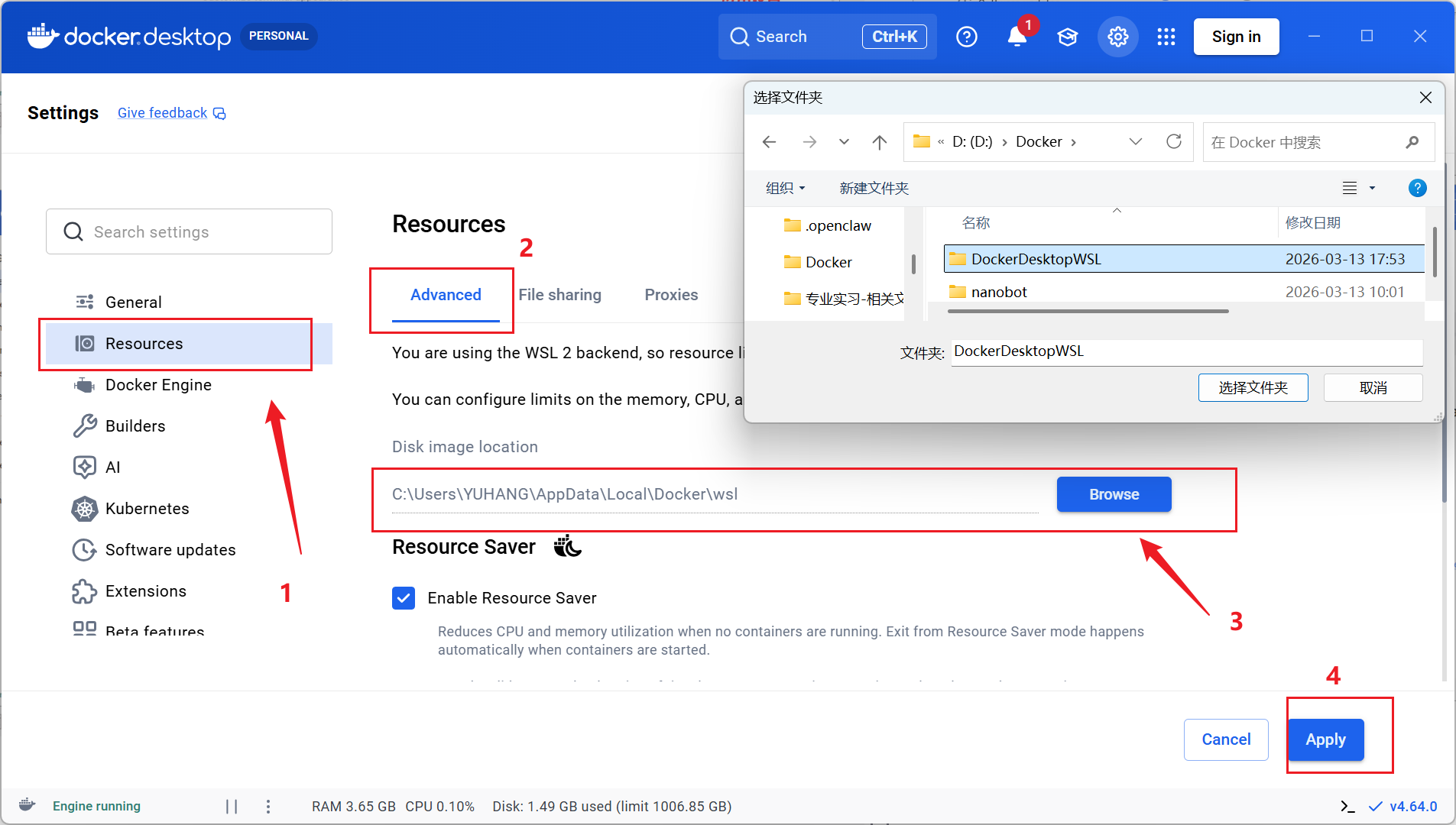

更改镜像的存储位置,默认为C盘,建议更改到其他盘符。

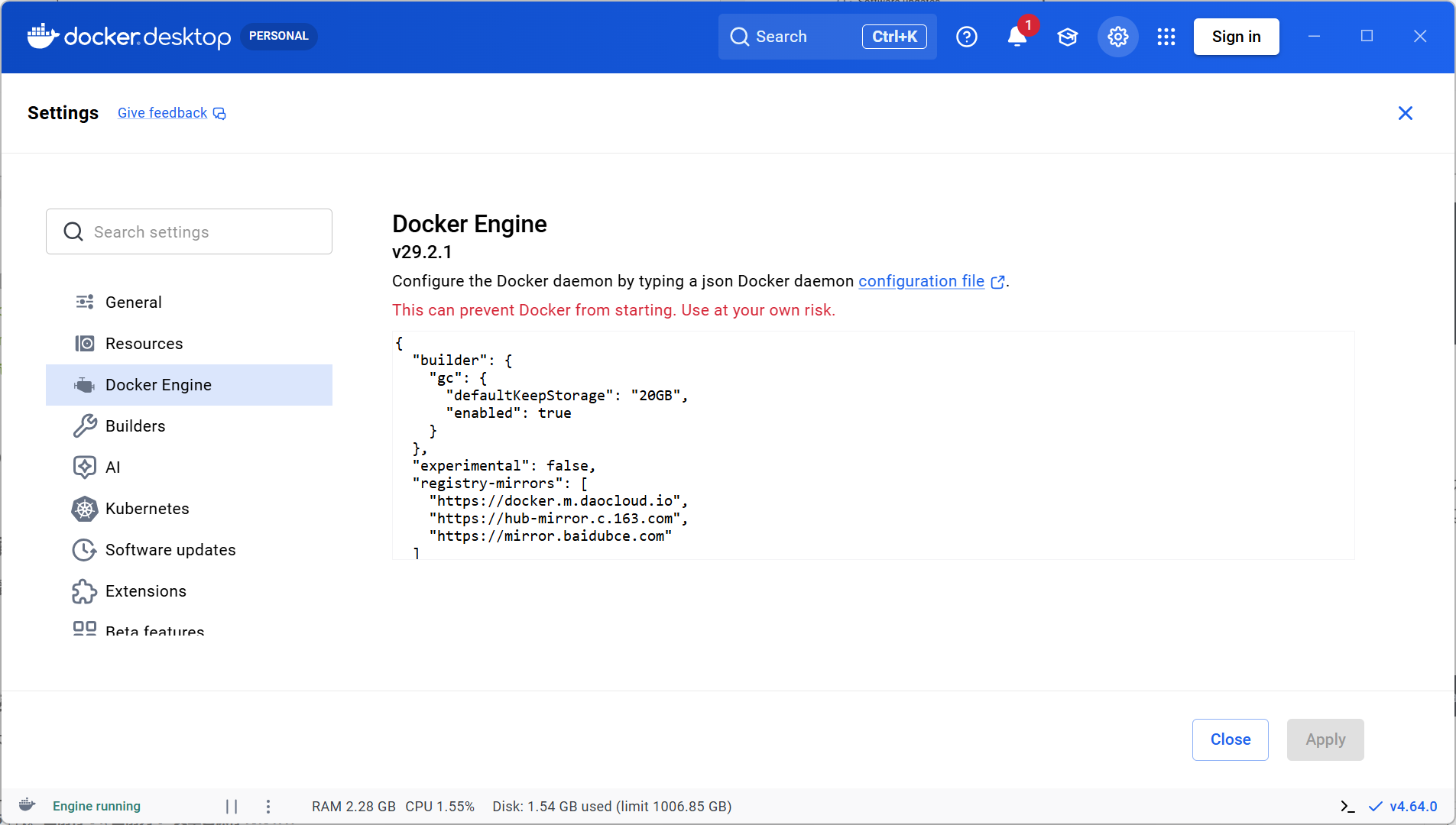

我们直接使用Docker获取镜像速度会很慢,更甚至会超时,下面更换国内的镜像源:

代码放在这里了直接复制即可

, "registry-mirrors": [

"https://docker.1ms.run",

"https://docker-0.unsee.tech",

"https://docker.m.daocloud.io"

]

好了到目前为止我们的Docker安装完成并配置好了,那么我们进行下一步。

二、在Docker中配置Ollama

Ollama 可以让你像安装普通软件一样简单地使用大模型,而 Docker 则让 Ollama 本身以及由它构建的整个AI应用(如知识库)的部署、管理和维护变得像搭积木一样简单可靠。 两者结合,是实现“本地AI自由”最优雅、最实用的路径。

方法1:仅仅安装CPU版本(方法2在下一篇)

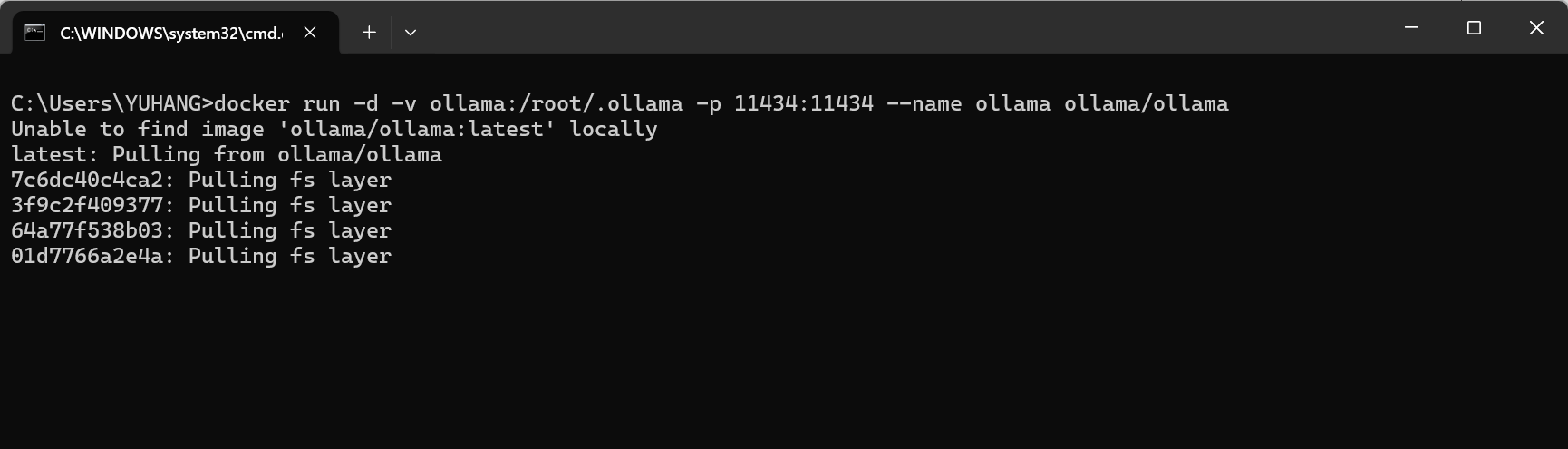

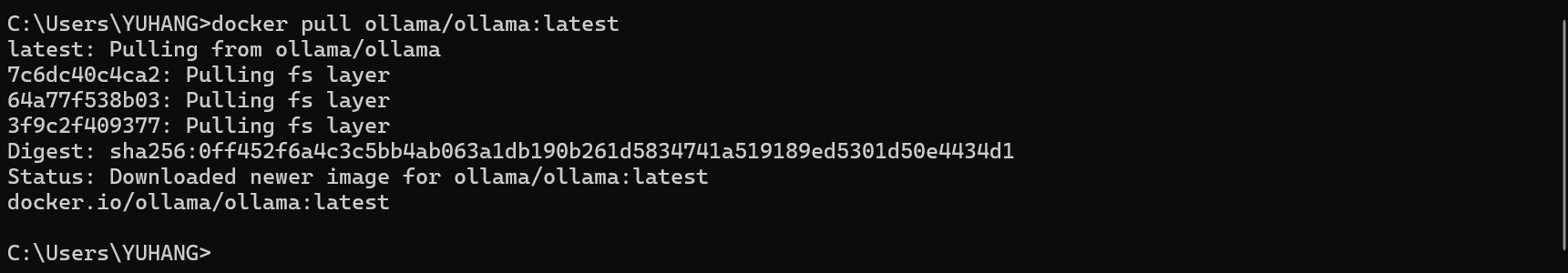

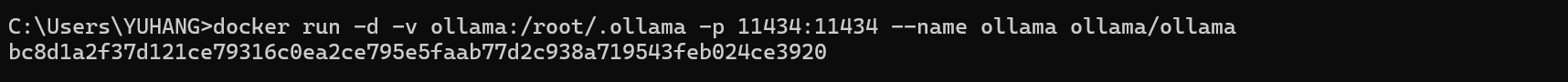

打开PowerShell输入以下指令:

docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

在没有镜像时,run指令会自动拉取镜像。

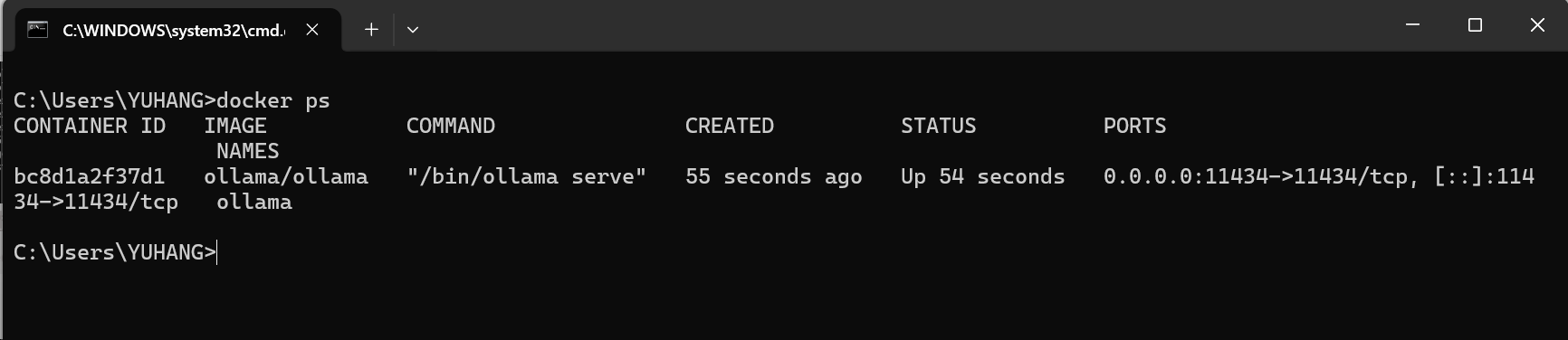

安装成功之后,运行以下指令查看安装好的Ollama:

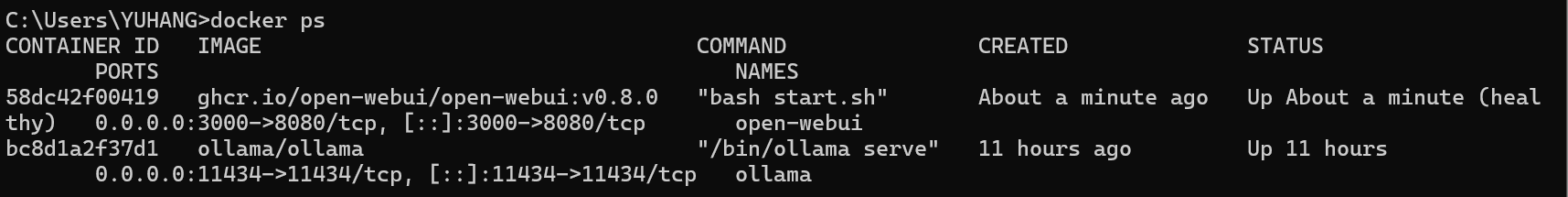

docker ps

Ollama下载模型

- 进入正在运行的Ollama 容器

docker exec -it ollama bash

- 在容器内使用 ollama pull命令下载模型

下面模型自己选择即可:

# 下载 Llama 3.2 3B 模型(约 1.8GB)

ollama pull llama3.2:3b

# 下载 Llama 3.2 1B 模型(更小更快)

ollama pull llama3.2:1b

# 下载 Qwen2.5 7B 模型(约 4.2GB)

ollama pull qwen2.5:7b

# 下载 deepseek-r1:8b 模型(约5.2GB)

ollama pull deepseek-r1:8b

# 下载 Phi-3 3.8B 模型(约 2.3GB)

ollama pull phi3:3.8b

# 下载 Mistral 7B 模型

ollama pull mistral:7b

- 退出容器

exit

- 列出所有已下载的模型

# 通过容器执行

docker exec ollama ollama list

# 或通过 API

curl http://localhost:11434/api/tags

三、在Docker中部署Open WebUI

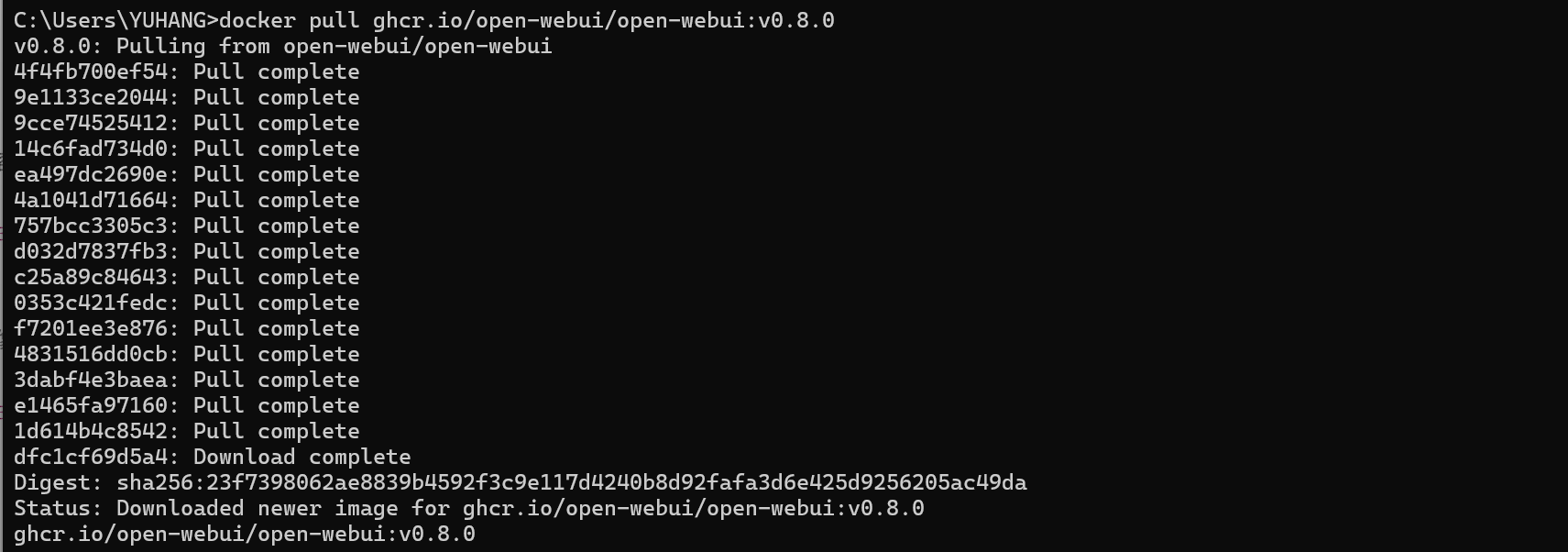

Open WebUI 可拉取的镜像分多个版本,可以根据需求安装指定的版本。

- 拉取镜像

# 最新版镜像

docker pull ghcr.io/open-webui/open-webui:main

# 精简版镜像

docker pull ghcr.io/open-webui/open-webui:main-slim

# 特定发布版镜像 稳定

docker pull ghcr.io/open-webui/open-webui:v0.8.0

- 运行容器

使用默认设置运行容器。此命令包含卷映射以确保数据的持久化存储。

docker run -d -p 3000:8080 -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main

如需改用精简版镜像

docker run -d -p 3000:8080 -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main-slim

使用 GPU 支持

docker run -d -p 3000:8080 --gpus all -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:cuda

单用户模式(禁用登录)

docker run -d -p 3000:8080 -e WEBUI_AUTH=False -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main

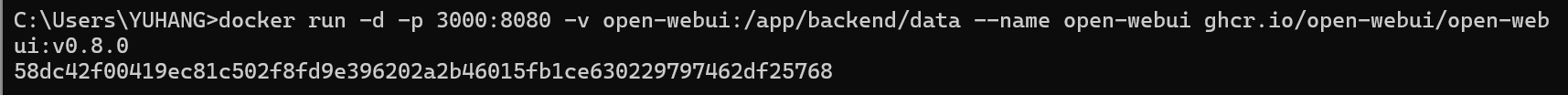

使用稳定版v0.8.0镜像

docker run -d -p 3000:8080 -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:v0.8.0

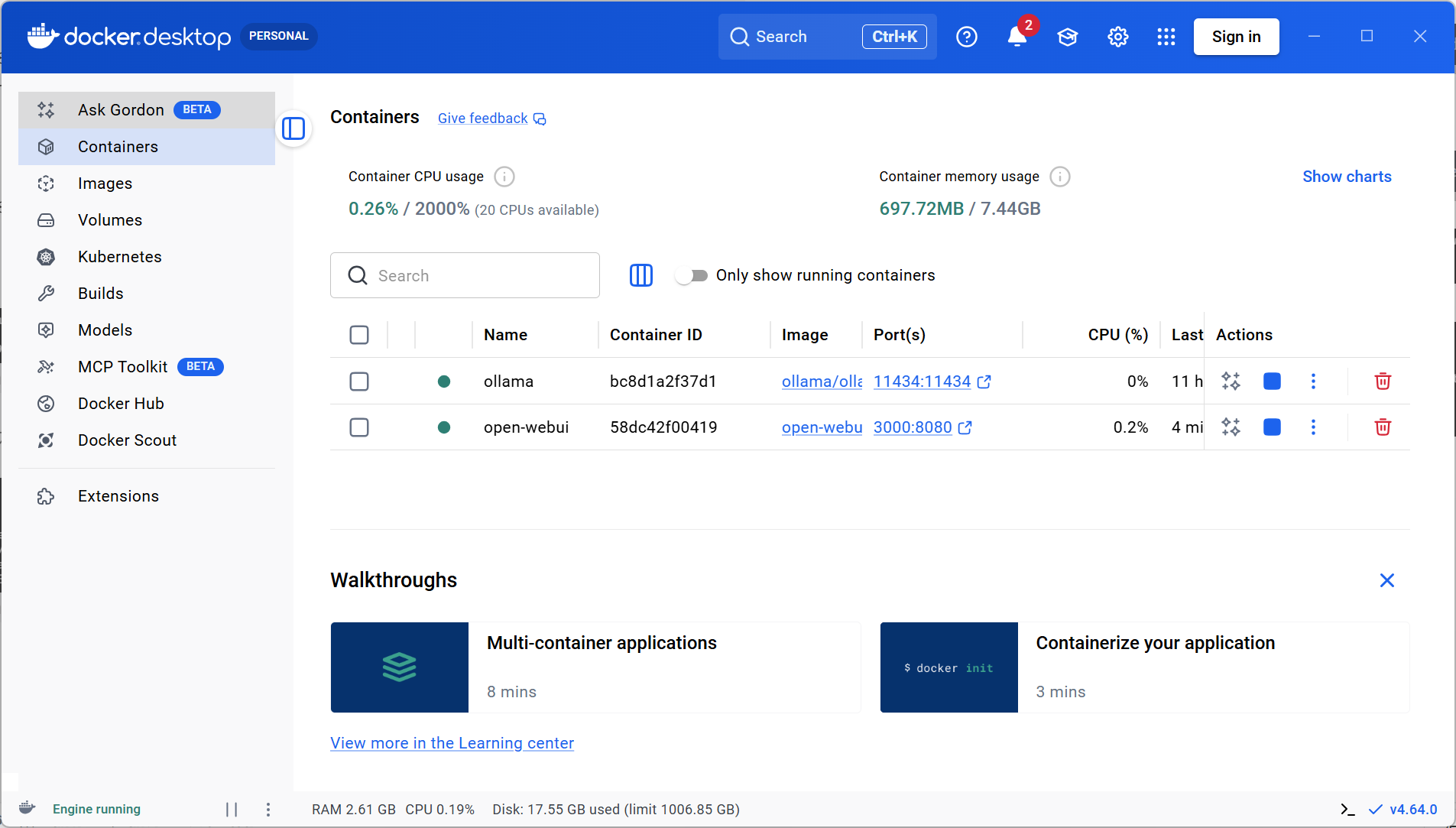

使用docker ps查看容器状态,或者直接打开Docker Desktop直接查看:

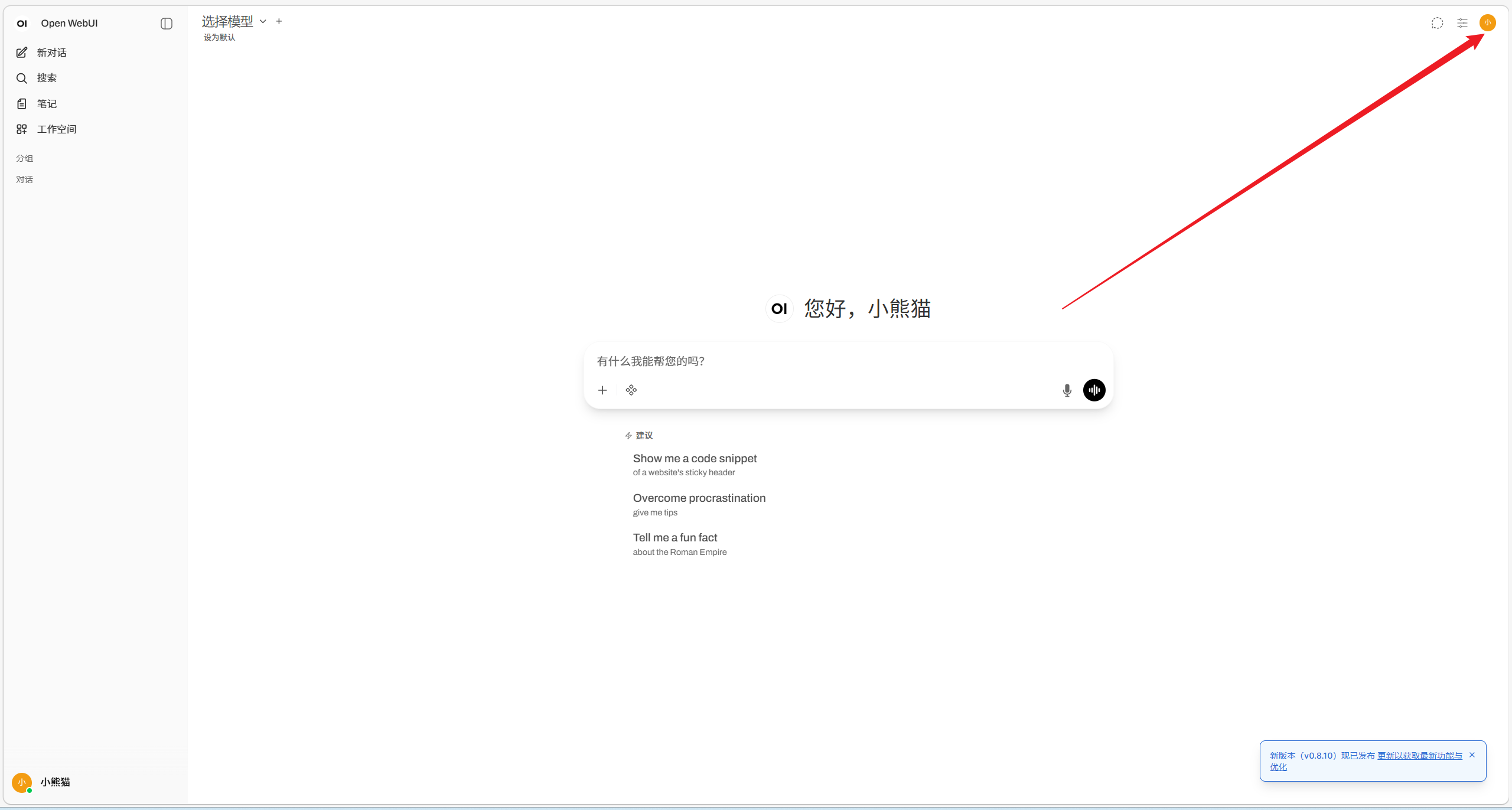

打开浏览器输入地址http://localhost:3000/进入Open WebUI界面,开始使用:

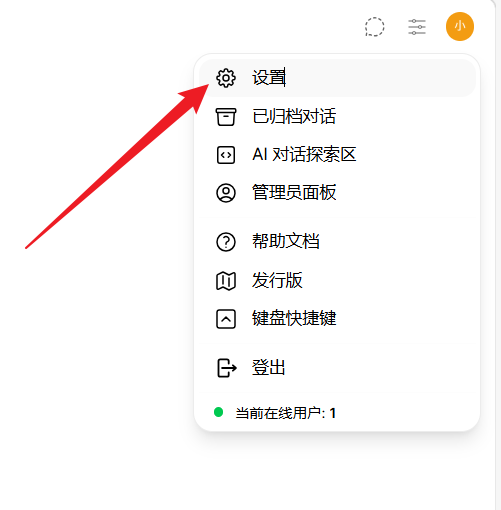

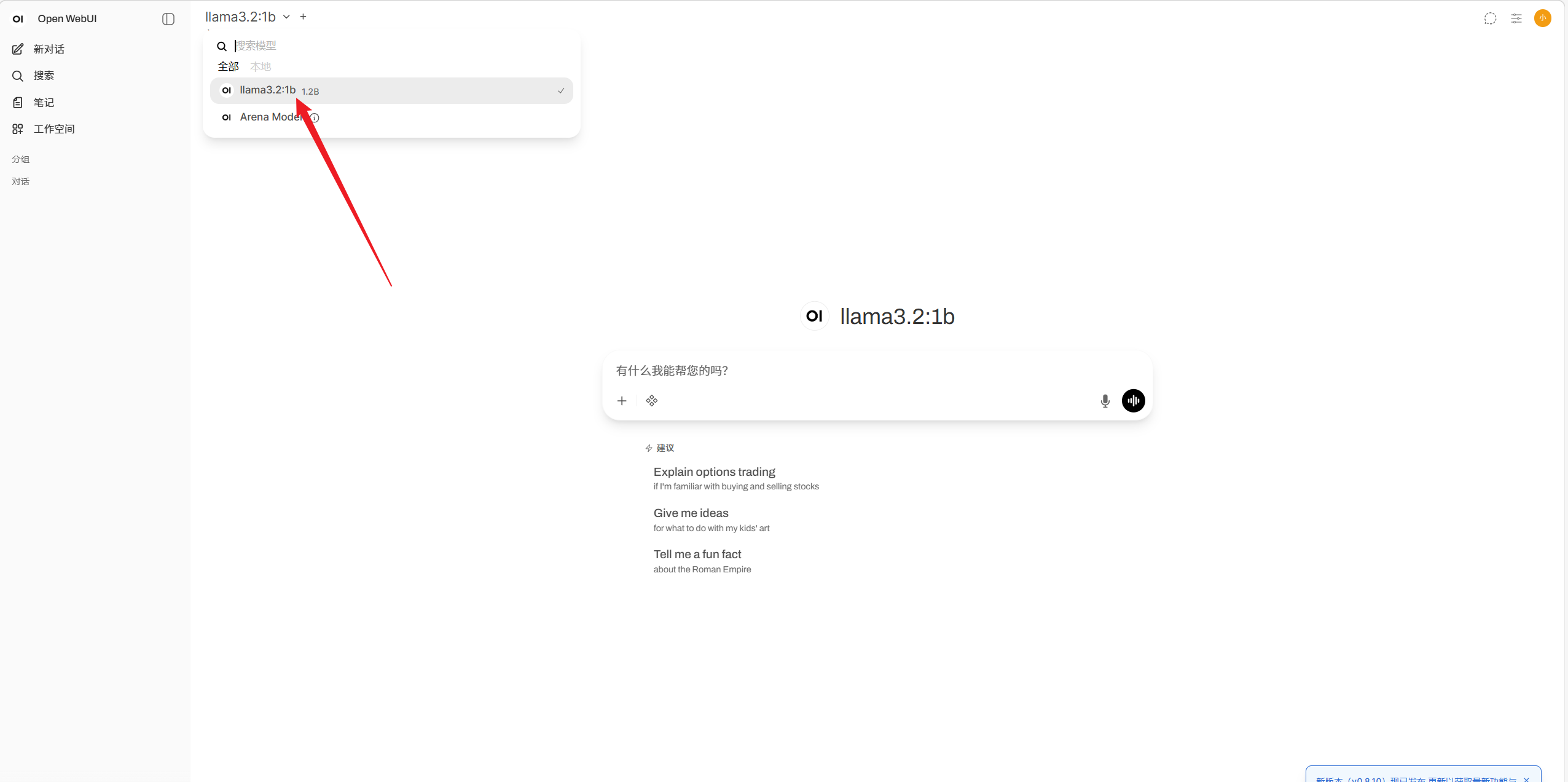

接着根据以下步骤连接Ollama

最后选择你的模型,可以开始对话了。

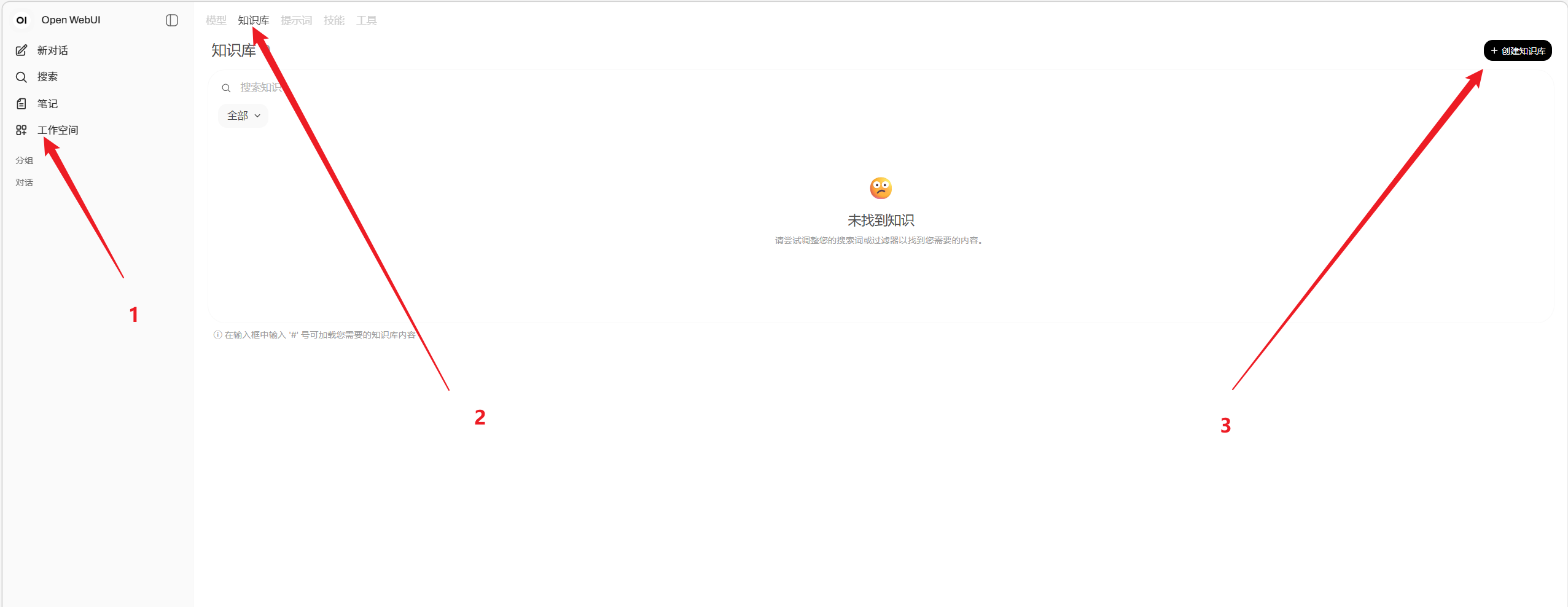

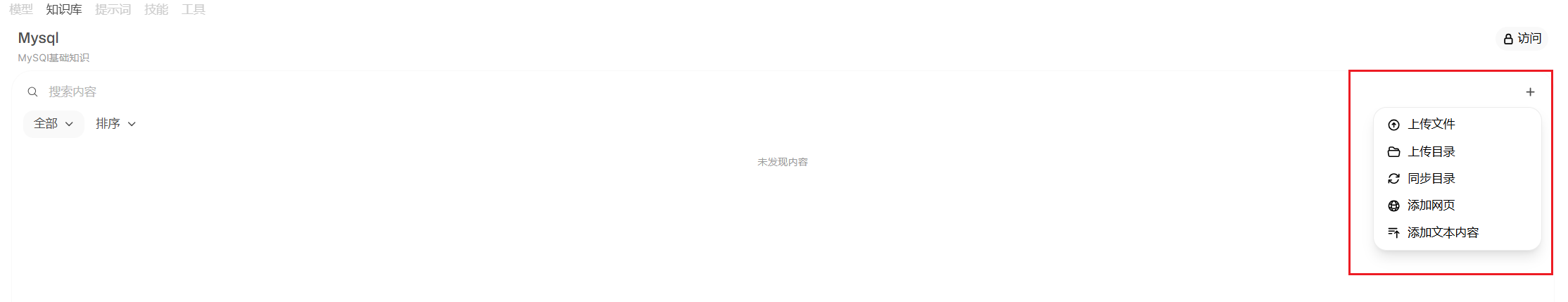

四、如何构建知识库

根据下图步骤添加你的文件,构建知识库。

结语

恭喜你!至此,你已经成功地在自己的电脑上,搭建起了一个完全私密、零成本、精准可靠的本地AI知识库。

回想一下,我们最初提到的那些痛点——数据隐私的担忧、使用成本的顾虑、AI幻觉的困扰、查找信息的低效——现在,都已被你亲手构建的这个“第二大脑”所化解。🚀

这不仅仅是完成了一次技术部署,更是你主动掌控个人数字资产、提升工作与学习效率的一次重要实践。你能让AI严格“学习”你提供的资料,并随时从中调取精准答案,这种感觉,是不是很棒?

🎯 接下来可以做什么?

- 投入日常使用:把它当作你的专属研究助理。开始整理和导入你最常查阅的文档、笔记、代码库,让它真正融入你的工作流。

- 探索更多玩法:除了问答,试试它的文档总结、内容创作、代码解释等能力。你喂给它的“食粮”越优质、越有针对性,它反馈给你的“营养”就越丰富。

- 持续优化调教:模型可以更换,提示词可以优化,界面可以定制。你的“知识管家”会随着你的使用和调教,变得越来越懂你。

💡 写在最后

我始终相信,最好的工具,是那些能无缝融入你现有习惯、并切实解决问题的工具。希望这个“开箱即用”的本地AI知识库方案,能成为你探索AI世界的一个踏实起点,而不仅仅是又一个“尝鲜即弃”的玩具。

如果你喜欢这种清晰、可复现、不折腾的教程风格,我在专栏里还分享了其他关于 AI工具、效率提升、开发实践 的深度内容。欢迎关注我,让我们一起,探索更多将前沿技术转化为个人生产力的可靠方法。

如果本教程对你有帮助,欢迎点赞、收藏,这将是对我最大的鼓励。也欢迎在评论区分享你的部署体验、使用技巧,或者遇到的任何问题。

技术之路,始于好奇,成于实践。让我们保持探索,下个工具再见! 👨💻👩💻

你的“知识管家”已上线,快去和它打个招呼吧!

转载自CSDN-专业IT技术社区

原文链接:https://blog.csdn.net/m0_74961596/article/details/159015222